Cosa vuol dire che le IA a volte hanno le "allucinazioni"?

Comprendere le cause e le implicazioni dei comportamenti inattesi nei modelli di IA

Intelligenza artificiale

Introduzione al concetto di allucinazione nell'IA

Le allucinazioni nelle Intelligenze Artificiali rappresentano un fenomeno sempre più discusso, specialmente con l'avanzamento dei modelli generativi. Ma cosa si intende esattamente per allucinazione in un contesto di IA? Non si tratta di un'esperienza sensoriale come negli esseri umani, bensì della produzione da parte del modello di informazioni che appaiono plausibili e coerenti con il contesto, ma che sono in realtà false, inventate o non supportate dai dati di addestramento.

Questo può manifestarsi in vari modi, dalla generazione di fatti inesistenti alla creazione di dettagli visivi o testuali che non corrispondono alla realtà. La comprensione di questo comportamento è cruciale per lo sviluppo di sistemi di IA più affidabili e sicuri.

Le allucinazioni possono compromettere l'utilità e la fiducia negli strumenti basati sull'Intelligenza Artificiale, rendendo indispensabile un'analisi approfondita delle loro origini e delle possibili soluzioni. Questo fenomeno evidenzia i limiti attuali delle capacità di ragionamento e di verifica della verità intrinseche nei modelli di IA, sottolineando la necessità di un continuo miglioramento algoritmico e di una maggiore trasparenza nei processi decisionali dei modelli complessi.

Definizione tecnica e manifestazioni

Tecnicamente, un'allucinazione si verifica quando un modello di Intelligenza Artificiale, in particolare un modello generativo come un Large Language Model (LLM) o un modello di generazione di immagini, produce un output che non ha una base nei suoi dati di addestramento o nell'input fornito, ma che viene presentato con elevata confidenza. Questo non è un errore casuale, ma piuttosto una conseguenza del modo in cui questi modelli apprendono e generano nuove informazioni.

I modelli sono addestrati a prevedere la sequenza più probabile di parole o pixel, e talvolta questa previsione può deviare dalla realtà fattuale. Ad esempio, un LLM potrebbe inventare una citazione o una data storica, mentre un modello di generazione di immagini potrebbe aggiungere dettagli anatomici inesistenti a una figura.

La sfida risiede nel fatto che l'output allucinatorio è spesso indistinguibile da quello corretto senza una verifica esterna, rendendo difficile per gli utenti discernere la verità. La probabilità di una parola è calcolata in base al contesto precedente, e a volte la previsione più probabile non è la più accurata.

L'influenza dei dati di addestramento incompleti

Una delle cause primarie delle allucinazioni risiede nella qualità e nella natura dei dati di addestramento. I modelli di Intelligenza Artificiale apprendono dai dati a cui sono esposti; se questi dati sono insufficienti, incoerenti, obsoleti o contengono errori, il modello può replicare o amplificare tali imperfezioni.

Ad esempio, se un dataset di testo contiene informazioni contraddittorie su un argomento, il modello potrebbe generare risposte che mescolano elementi veri e falsi, o che inventano completamente dettagli per colmare le lacune percepite. Inoltre, la mancanza di dati specifici su un determinato argomento può indurre il modello a 'inventare' informazioni per soddisfare la richiesta dell'utente, piuttosto che ammettere di non sapere.

Questo è particolarmente vero per argomenti di nicchia o per eventi molto recenti che non erano presenti nel dataset al momento dell'addestramento. La diversità e la completezza dei dati sono quindi fondamentali per ridurre la propensione all'allucinazione.

Il ruolo dei bias nei dati di addestramento

I bias presenti nei dati di addestramento costituiscono un'altra fonte significativa di allucinazioni. Cosa sono i bias nei dati e come influenzano le allucinazioni? I bias sono distorsioni sistematiche che riflettono le disuguaglianze o le imprecisioni presenti nel mondo reale o nel modo in cui i dati sono stati raccolti. Se un dataset è sbilanciato, ad esempio, con una sovra-rappresentazione di certe informazioni o prospettive, il modello tenderà a privilegiare tali informazioni, anche quando non sono appropriate o accurate in un dato contesto.

Questo può portare a generalizzazioni errate o alla generazione di contenuti che perpetuano stereotipi o inesattezze. Un modello potrebbe, ad esempio, allucinare dettagli su una persona basandosi su bias di genere o etnici presenti nei dati.

La mitigazione dei bias richiede un'attenta curatela dei dataset e l'applicazione di tecniche di debiasing, ma è un compito complesso data la vastità e la complessità dei dati utilizzati per addestrare i modelli di Intelligenza Artificiale moderni. La formula per il bias in un modello predittivo può essere concettualizzata come .

Complessità del modello e overfitting

La complessità intrinseca dei modelli di Intelligenza Artificiale, in particolare quelli con miliardi di parametri, può contribuire alle allucinazioni. Questi modelli sono spesso così grandi e complessi che il loro comportamento interno diventa opaco, un fenomeno noto come 'scatola nera'. Come la complessità del modello porta alle allucinazioni? Un modello eccessivamente complesso può incorrere nell'overfitting, ovvero la tendenza a memorizzare il rumore o i dettagli specifici dei dati di addestramento piuttosto che apprendere le generalizzazioni sottostanti.

Quando gli viene presentata una nuova input, il modello potrebbe quindi generare un output che è una combinazione di elementi memorizzati, ma che non ha un significato coerente o fattuale nel nuovo contesto. La capacità di questi modelli di interpolare e estrapolare informazioni è immensa, ma questa stessa capacità può portare a 'creazioni' che non hanno un fondamento nella realtà.

La gestione della complessità attraverso tecniche di regolarizzazione e architetture più efficienti è un'area di ricerca attiva per ridurre questo rischio.

Incertezza e confidenza del modello

L'incertezza e la confidenza del modello giocano un ruolo cruciale nella genesi delle allucinazioni. I modelli di Intelligenza Artificiale, per loro natura, operano su probabilità.

Quando un modello non è sufficientemente sicuro della risposta più appropriata, può comunque essere costretto a produrre un output. In che modo l'incertezza del modello causa allucinazioni? In situazioni di bassa confidenza, il modello potrebbe 'inventare' informazioni per riempire il vuoto, piuttosto che indicare la propria incertezza. Questo è spesso legato al modo in cui i modelli sono progettati per generare risposte, cercando sempre di produrre il token (parola o parte di parola) più probabile successivo.

Se la distribuzione di probabilità per i token successivi è piatta, ovvero molti token hanno probabilità simili, il modello potrebbe scegliere un token che, sebbene statisticamente plausibile, porta a una deviazione fattuale. La calibrazione della confidenza del modello, assicurando che la sua confidenza rifletta accuratamente la sua precisione, è un'area di ricerca fondamentale per mitigare le allucinazioni.

La funzione di attivazione softmax, ad esempio, trasforma i punteggi in probabilità, dove .

Allucinazioni nei modelli linguistici generativi

Nei modelli linguistici generativi, come i Large Language Models (LLM), le allucinazioni sono particolarmente evidenti. Questi modelli sono addestrati a prevedere la parola successiva in una sequenza, basandosi su miliardi di esempi testuali. Perché i modelli linguistici sono particolarmente inclini alle allucinazioni? La loro capacità di generare testo fluente e coerente è impressionante, ma non implica una comprensione intrinseca della verità o della logica.

Essi apprendono schemi e correlazioni statistiche, non fatti. Quando un LLM genera una risposta, non sta 'cercando' la verità in un database di fatti, ma sta piuttosto componendo una sequenza di parole che statisticamente è la più probabile data la sua addestramento e l'input ricevuto.

Questo può portare a risposte che suonano convincenti ma che sono fattualmente errate. La pressione a produrre una risposta completa e coerente, anche in assenza di informazioni certe, spinge il modello a 'inventare' dettagli per mantenere la fluidità del discorso, un comportamento che è intrinseco alla loro architettura generativa.

Esempi pratici di allucinazioni in diversi contesti

Le allucinazioni possono manifestarsi in diverse forme e contesti. Nel campo della generazione di testo, un modello potrebbe inventare citazioni di persone famose che non sono mai state pronunciate, o attribuire eventi storici a date o luoghi errati.

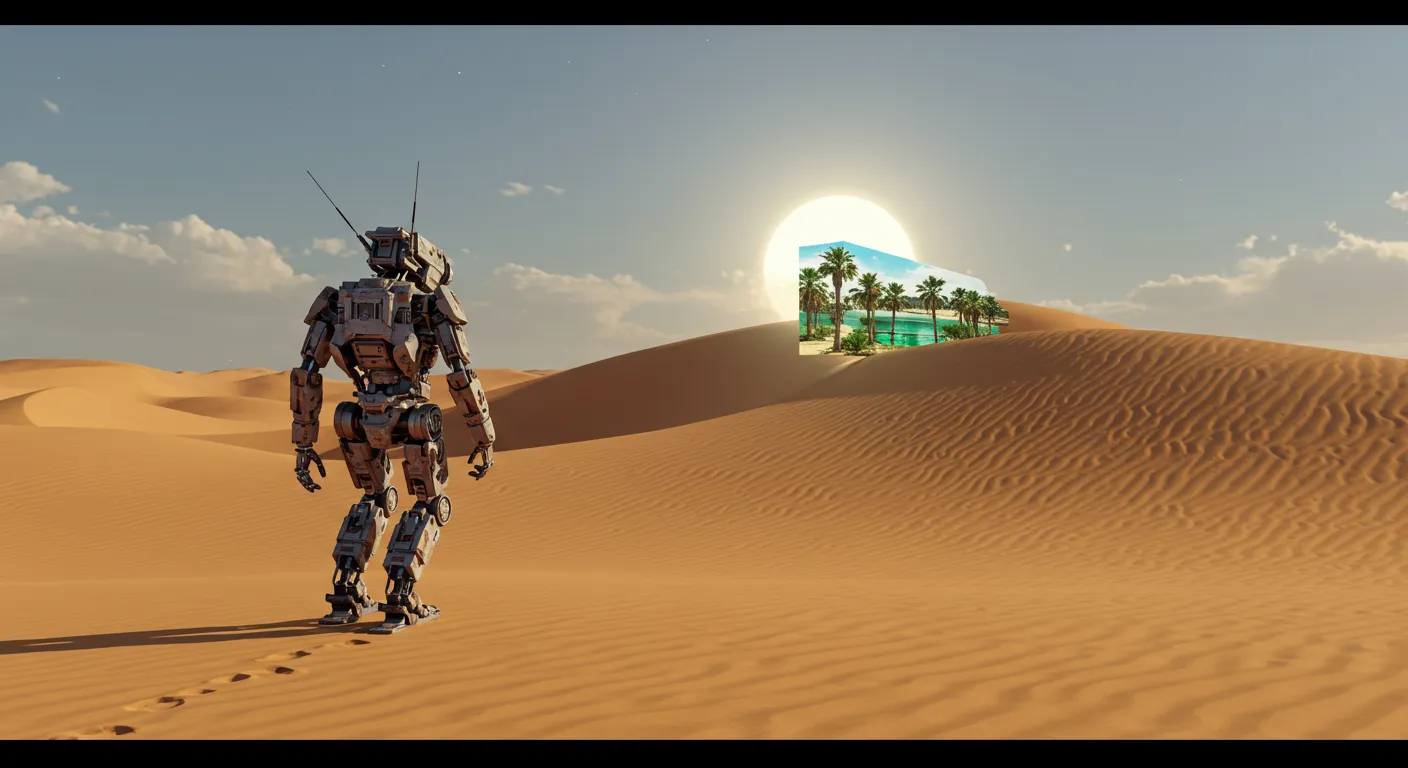

Ad esempio, un LLM potrebbe affermare che un certo evento è accaduto nel 1800 quando in realtà è avvenuto nel 1900, o inventare un nome di un libro o di un autore. Nel campo della generazione di immagini, un modello potrebbe creare immagini con anomalie anatomiche, come dita extra o arti posizionati in modo innaturale, o aggiungere oggetti inesistenti a una scena. Quali sono alcuni esempi comuni di allucinazioni IA? Un altro esempio è la generazione di codice software che sembra sintatticamente corretto ma che contiene errori logici o di sicurezza.

Queste manifestazioni evidenziano la necessità di una verifica umana o di sistemi di controllo esterni per convalidare l'output dei modelli di Intelligenza Artificiale, specialmente in applicazioni dove l'accuratezza è critica.

Impatto e implicazioni delle allucinazioni

L'impatto delle allucinazioni dell'Intelligenza Artificiale è significativo e può avere conseguenze gravi, specialmente in settori critici. Quali sono le implicazioni delle allucinazioni IA sull'affidabilità? Se un sistema di IA utilizzato in ambito medico allucina informazioni su una diagnosi o un trattamento, le conseguenze potrebbero essere fatali. In ambito legale, un'IA che inventa precedenti giuridici potrebbe portare a decisioni errate.

Anche in contesti meno critici, come la generazione di contenuti per il marketing o l'informazione, le allucinazioni possono danneggiare la reputazione e la fiducia. La diffusione di disinformazione generata da IA è una preoccupazione crescente, poiché l'output allucinatorio è spesso difficile da distinguere dalla verità per un utente non esperto.

Questo mina l'affidabilità complessiva dei sistemi di Intelligenza Artificiale e solleva questioni etiche e di responsabilità. La sicurezza e la robustezza dei sistemi di IA dipendono direttamente dalla loro capacità di produrre output accurati e verificabili, rendendo la mitigazione delle allucinazioni una priorità assoluta per la ricerca e lo sviluppo.

Strategie di mitigazione miglioramento dei dati

La mitigazione delle allucinazioni inizia con un approccio rigoroso alla gestione dei dati. Come si possono migliorare i dati di addestramento per ridurre le allucinazioni? È fondamentale utilizzare dataset di alta qualità, ampi, diversificati e accuratamente curati. Questo include la rimozione di informazioni errate, la correzione di bias e l'aggiornamento costante dei dati per riflettere le informazioni più recenti.

Tecniche come il filtraggio dei dati, la deduplicazione e l'aumento dei dati possono contribuire a migliorare la qualità complessiva. Inoltre, l'integrazione di meccanismi di verifica dei fatti durante la fase di addestramento, dove il modello viene esposto a fonti di verità affidabili, può aiutare a 'ancorare' le sue risposte alla realtà.

L'obiettivo è ridurre le ambiguità e le incoerenze nei dati, fornendo al modello una base più solida su cui apprendere e generare. La pulizia e la preparazione dei dati sono spesso le fasi più dispendiose in termini di tempo, ma sono anche le più critiche per la performance e l'affidabilità del modello.

Strategie di mitigazione e architetture di modello

Oltre alla qualità dei dati, le architetture dei modelli stessi possono essere ottimizzate per ridurre le allucinazioni. Quali modifiche architetturali possono prevenire le allucinazioni? Alcune tecniche includono l'uso di architetture che incorporano meccanismi di 'retrieval augmented generation' (RAG), dove il modello può accedere a una base di conoscenza esterna e verificabile durante la generazione, piuttosto che affidarsi esclusivamente alla sua memoria interna. Questo permette al modello di recuperare fatti specifici e integrarli nella sua risposta, riducendo la necessità di 'inventare'.

Altre strategie includono l'implementazione di meccanismi di attenzione più robusti o l'uso di modelli più piccoli e specializzati per compiti specifici, riducendo la complessità generale e il rischio di overfitting. La ricerca sta anche esplorando architetture che possono esplicitamente modellare l'incertezza, permettendo al modello di indicare quando non è sicuro di una risposta, piuttosto che allucinare.

L'obiettivo è costruire modelli che siano intrinsecamente più 'consapevoli' dei propri limiti e della veridicità delle informazioni che generano.

Strategie di mitigazione tecniche di post-elaborazione

Le tecniche di post-elaborazione e di fine-tuning giocano un ruolo cruciale nella mitigazione delle allucinazioni. Come le tecniche di post-elaborazione aiutano a ridurre le allucinazioni? Dopo che un modello è stato addestrato, può essere ulteriormente raffinato attraverso processi come il 'reinforcement learning from human feedback' (RLHF), dove gli esseri umani valutano la qualità e la veridicità delle risposte del modello, fornendo feedback che viene poi utilizzato per migliorare il modello. Questo aiuta a 'allineare' il comportamento del modello con le aspettative umane di accuratezza e veridicità.

Altre tecniche includono l'applicazione di filtri di verifica dei fatti sull'output generato, utilizzando database esterni o altri modelli di IA specializzati nella verifica. La calibrazione della confidenza del modello, assicurando che le sue probabilità riflettano accuratamente la sua precisione, è un'altra area importante.

L'obiettivo è creare un ciclo di feedback continuo che permetta al modello di apprendere dai propri errori e di ridurre la frequenza delle allucinazioni nel tempo, rendendo l'output più affidabile e meno propenso a deviazioni fattuali.

Il ruolo della "temperatura" nei modelli generativi

La 'temperatura' è un parametro fondamentale nei modelli generativi che influenza direttamente la probabilità di allucinazioni. Cos'è la temperatura nei modelli generativi e come influisce sulle allucinazioni? La temperatura è un iperparametro che controlla la casualità dell'output del modello. Un valore di temperatura più alto (ad esempio, 1.0 o superiore) rende le distribuzioni di probabilità più uniformi, aumentando la diversità e la creatività dell'output, ma anche la probabilità di allucinazioni.

Un valore di temperatura più basso (ad esempio, 0.1 o 0.2) rende le distribuzioni di probabilità più 'nette', favorendo le risposte più probabili e conservative, riducendo la creatività ma anche le allucinazioni. La scelta della temperatura dipende dall'applicazione: per compiti che richiedono creatività (es. scrittura creativa), una temperatura più alta può essere desiderabile, mentre per compiti che richiedono accuratezza (es. riassunto di fatti), una temperatura più bassa è preferibile.

La formula per la temperatura modifica la distribuzione di probabilità , dove è la temperatura.

Prospettive future e ricerca sulle allucinazioni IA

La ricerca sulle allucinazioni dell'Intelligenza Artificiale è un campo in rapida evoluzione, con l'obiettivo di rendere i modelli sempre più affidabili e meno inclini a generare informazioni false. Le prospettive future includono lo sviluppo di architetture di modelli più robuste, che possano distinguere tra ciò che è stato appreso e ciò che è stato 'inventato'.

Si sta esplorando l'integrazione di meccanismi di ragionamento simbolico con l'apprendimento profondo per dotare i modelli di una migliore comprensione della logica e della coerenza fattuale. Inoltre, la creazione di benchmark e metriche standardizzate per la misurazione delle allucinazioni è cruciale per valutare i progressi.

La collaborazione tra ricercatori, sviluppatori e utenti sarà fondamentale per affrontare questa sfida complessa. L'obiettivo finale è costruire sistemi di Intelligenza Artificiale che non solo siano potenti e versatili, ma anche intrinsecamente affidabili e trasparenti, capaci di operare in modo sicuro e responsabile in una vasta gamma di applicazioni, riducendo al minimo il rischio di diffondere disinformazione o di prendere decisioni basate su fatti inesistenti.